LangChain ir ietvars ar lietojumprogrammu Natural Language Processing jeb NLP domēnā, lai izveidotu modeļus cilvēkiem līdzīgās valodās. Šos modeļus cilvēki var izmantot, lai saņemtu atbildes no modeļa vai sarunātos kā jebkurš cits cilvēks. LangChain izmanto, lai izveidotu ķēdes, saglabājot katru sarunas teikumu un tālāk mijiedarbojoties, izmantojot to kā kontekstu.

Šī ziņa ilustrēs LLM un LLMChain veidošanas procesu LangChain.

Kā izveidot LLM un LLMChain programmā LangChain?

Lai izveidotu LLM un LLMChain programmā LangChain, vienkārši veiciet norādītās darbības:

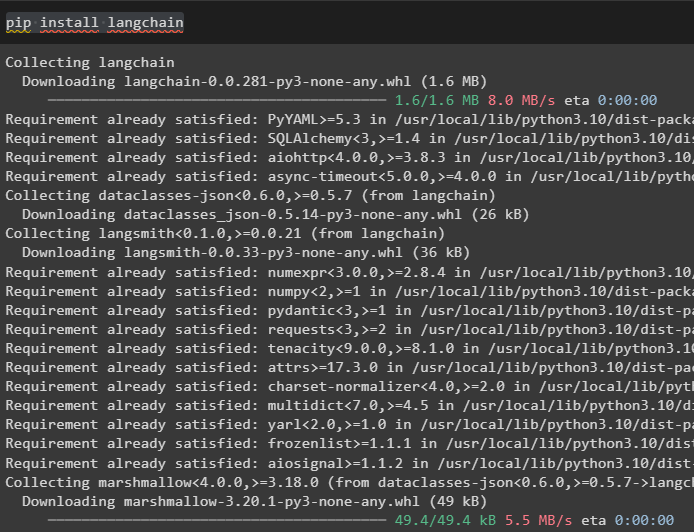

1. darbība: instalējiet moduļus

Pirmkārt, instalējiet moduli LangChain, lai izmantotu tā bibliotēkas LLM un LLMChain veidošanai:

pip instalēt langchain

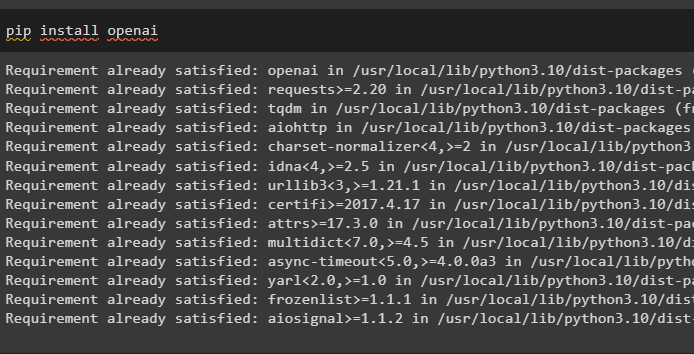

Vēl viens modulis, kas nepieciešams, lai izveidotu LLM, ir OpenAI, un to var instalēt, izmantojot pip komandu:

pip install openai

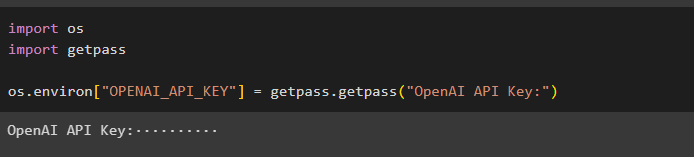

2. darbība: iestatiet vidi

Iestatiet vidi, izmantojot OpenAI API atslēgu no tās vides:

importē mūsimportēt getpassos.environ['OPENAI_API_KEY'] = getpass.getpass('OpenAI API atslēga:')

1. piemērs: LLM izveide, izmantojot LangChain

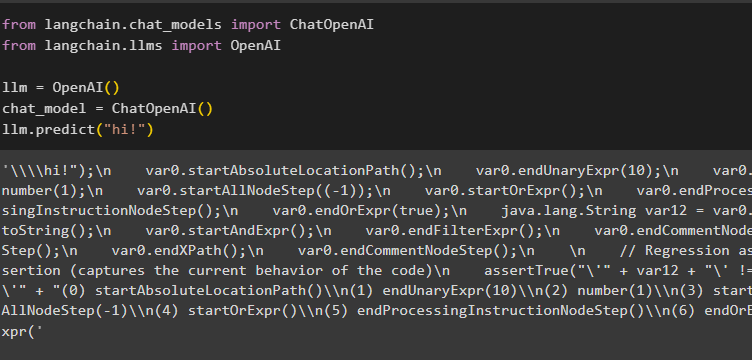

Pirmais piemērs ir izveidot lielo valodu modeļus, izmantojot LangChain, importējot OpenAI un ChatOpenAI bibliotēkas un izmantojot funkciju llm().

1. darbība. LLM tērzēšanas modeļa izmantošana

Importējiet OpenAI un ChatOpenAI moduļus, lai izveidotu vienkāršu LLM, izmantojot OpenAI vidi no LangChain:

no langchain.chat_models importējiet ChatOpenAIno langchain.llms importēt OpenAI

llm = OpenAI()

chat_model = ChatOpenAI()

llm.predict('čau!')

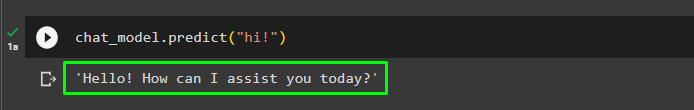

Modelis ir atbildējis ar “sveiki”, kā parādīts tālāk esošajā ekrānuzņēmumā:

Funkcija prognozēt() no chat_model tiek izmantota, lai iegūtu atbildi vai atbildi no modeļa:

chat_model.predict('čau!')Izvade parāda, ka modelis ir lietotāja rīcībā, kas uzdod jautājumus:

2. darbība: teksta vaicājuma izmantošana

Lietotājs var arī saņemt atbildes no modeļa, teksta mainīgajā norādot visu teikumu:

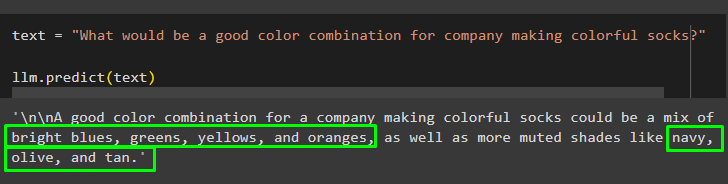

text = 'Kāds būtu labs uzņēmuma nosaukums uzņēmumam, kas ražo krāsainas zeķes?'llm.predict(text)

Modelis ir parādījis vairākas krāsu kombinācijas krāsainām zeķēm:

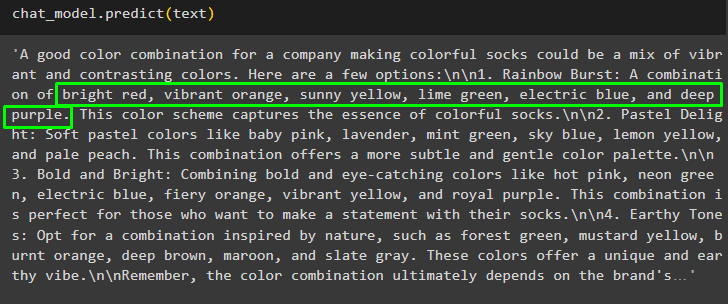

Saņemiet detalizētu atbildi no modeļa, izmantojot funkciju prognozēt() ar zeķu krāsu kombinācijām:

chat_model.predict(text)

3. darbība: teksta izmantošana ar saturu

Lietotājs var saņemt atbildi ar nelielu paskaidrojumu par atbildi:

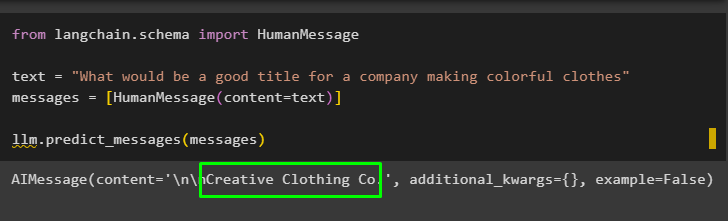

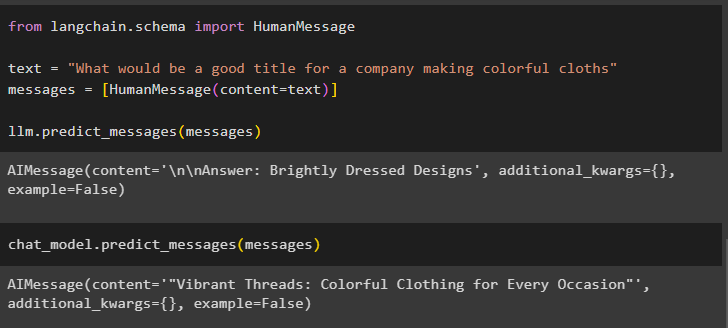

no langchain.schema importa HumanMessagetext = 'Kāds būtu labs nosaukums uzņēmumam, kas ražo krāsainus apģērbus'

ziņojumi = [HumanMessage(content=text)]

llm.predict_messages(ziņojumi)

Modelis ir radījis nosaukumu uzņēmumam “Creative Clothing Co”:

Paredziet ziņojumu, lai saņemtu atbildi arī par uzņēmuma nosaukumu ar tā skaidrojumu:

chat_model.predict_messages(ziņojumi)

2. piemērs: izveidojiet LLMChain, izmantojot LangChain

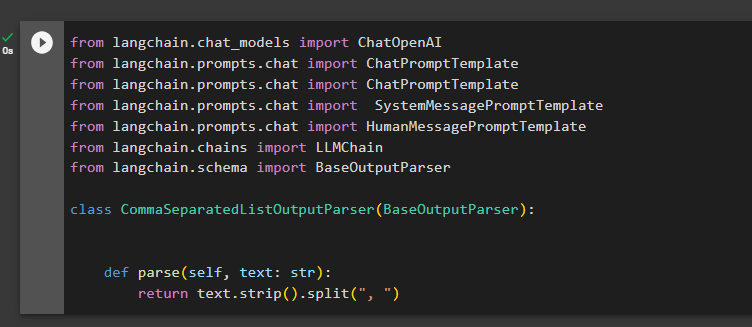

Mūsu rokasgrāmatas otrajā piemērā ir izveidota LLMChain, lai iegūtu modeli cilvēka mijiedarbības formātā, lai apvienotu visas iepriekšējā piemēra darbības:

no langchain.chat_models importējiet ChatOpenAIno langchain.prompts.chat importēt ChatPromptTemplate

no langchain.prompts.chat importēt ChatPromptTemplate

no langchain.prompts.chat importēšanas SystemMessagePromptTemplat no langchain.prompts.chat importa HumanMessagePromptTemplate

no langchain.chains importēt LLMChain

no langchain.schema importēšanas BaseOutputParserclass CommaSeparatedListOutputParser(BaseOutputParser):

def parse(self, text: str):

atgriezt text.strip().split(', ')

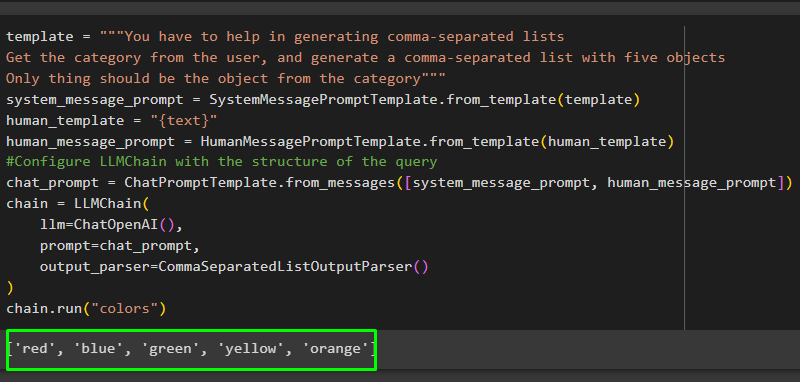

Izveidojiet tērzēšanas modeļa veidni, sniedzot detalizētu skaidrojumu par tā darbību, un pēc tam izveidojiet funkciju LLMChain(), kas satur LLM, izvades parsētāju un chat_prompt bibliotēkas:

template = '''Jums jāpalīdz izveidot ar komatu atdalītus sarakstusIegūstiet kategoriju no lietotāja un ģenerējiet ar komatu atdalītu sarakstu ar pieciem objektiem

Vienīgajam ir jābūt objektam no kategorijas'''

system_message_prompt = SystemMessagePromptTemplate.from_template(veidne)

human_template = '{teksts}'

human_message_prompt = HumanMessagePromptTemplate.from_template(cilvēka_veidne)

#Konfigurējiet LLMChain ar vaicājuma struktūru

chat_prompt = ChatPromptTemplate.from_messages([system_message_prompt, human_message_prompt])

ķēde = LLMChain(

llm=ChatOpenAI(),

prompt=chat_prompt,

output_parser=CommaSeparatedListOutputParser()

)

chain.run('krāsas')

Modelis ir sniedzis atbildi ar krāsu sarakstu, jo kategorijā drīkst būt tikai 5 uzvednē norādītie objekti:

Tas viss attiecas uz LLM un LLMChain izveidi LangChain.

Secinājums

Lai izveidotu LLM un LLMChain, izmantojot LangChain, vienkārši instalējiet LangChain un OpenAI moduļus, lai iestatītu vidi, izmantojot tās API atslēgu. Pēc tam izveidojiet LLM modeli, izmantojot chat_model, pēc tam, kad ir izveidota uzvednes veidne vienam vaicājumam pilnai tērzēšanai. LLMChain tiek izmantotas, lai izveidotu visu sarunas novērojumu ķēdes un izmantotu tās kā mijiedarbības kontekstu. Šī ziņa ilustrē LLM un LLMChain veidošanas procesu, izmantojot LangChain sistēmu.